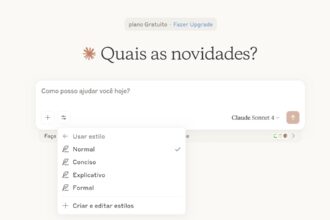

A prática de “vibe coding”, o acto de descrever uma aplicação em linguagem natural e deixar que a inteligência artificial a construa em minutos, tem ganho uma enorme popularidade. Qualquer pessoa, desde profissionais de marketing a estagiários, consegue agora desenvolver software sem conhecimentos técnicos. No entanto, esta facilidade e rapidez têm um preço elevado. A tendência está a trazer um aumento massivo de vulnerabilidades de segurança.

Recentemente, a empresa de cibersegurança RedAccess partilhou descobertas alarmantes. De acordo com um artigo da Wired, a equipa de investigação identificou cerca de cinco mil aplicações web criadas através de ferramentas populares de inteligência artificial, como o Lovable, o Replit e o Netlify, que tinham falhas graves de protecção dos dados. Em muitos casos, estas plataformas estavam indexadas pelo Google, o que significa que qualquer pessoa a utilizar o motor de busca ou um simples browser conseguia aceder a informações empresariais sensíveis.

Os dados expostos não se limitam a texto de preenchimento. Os investigadores encontraram escalas de trabalho de hospitais, estratégias de mercado, registos de vendas e até conversas privadas de pacientes. Como as ferramentas de “vibe coding” permitem que pessoas sem formação técnica publiquem software, conceitos básicos como a autenticação ou o acesso privado acabam por ficar completamente esquecidos.

O debate sobre a responsabilidade

As empresas que desenvolvem estas plataformas de inteligência artificial já vieram a público defender as suas posições. O Replit e a Wix (proprietária do Base44) argumentam que, se uma aplicação está pública, é porque o utilizador escolheu essa configuração. Estas entidades mantêm a ideia de que um endereço web público não constitui uma falha de segurança, mas sim o comportamento esperado de uma ferramenta desenhada para partilhar conteúdos.

Apesar de esta afirmação ser tecnicamente verdadeira, os especialistas em segurança indicam que o problema é estrutural. Quando uma ferramenta é promovida para utilizadores que não são engenheiros informáticos, as configurações predefinidas assumem o papel de modelo de segurança. Se a opção padrão for “público”, um utilizador que não compreende a arquitectura web vai, sem intenção, deixar a porta virtual escancarada para a Internet. Este cenário agrava-se quando percebemos que as ameaças digitais estão a evoluir, tal como se verificou quando a Google analisou várias famílias de software malicioso geradas por inteligência artificial com resultados preocupantes, o que mostra que a protecção de dados tem de ser uma prioridade desde a concepção.

A ascensão da inteligência artificial paralela

Este fenómeno representa uma nova forma de “Shadow IT” (tecnologias de informação paralelas). Os funcionários das empresas estão a recorrer à inteligência artificial para criar sistemas de rastreamento de clientes, portais de apoio ou páginas de relatórios para poupar tempo e executar tarefas de forma mais rápida. Estas ferramentas funcionam suficientemente bem para se tornarem sistemas de produção não oficiais, mas nunca passam por uma revisão de segurança. Aquilo que começa como uma experiência rápida acaba por alojar dados reais de clientes ou registos financeiros internos na web aberta.

O “vibe coding” não vai desaparecer, uma vez que a eficiência que oferece é demasiado alta para ser ignorada. Contudo, a próxima fase do desenvolvimento de inteligência artificial precisa de dar prioridade à segurança em detrimento da velocidade pura. Os especialistas sugerem que as plataformas devem ser privadas por defeito e incluir avisos claros sempre que uma aplicação estiver a aceder a fontes de dados sensíveis.

O potencial desta forma de programar é tremendo. Porém, antes de passar um protótipo construído por inteligência artificial para o mundo real, deve ser obrigatório verificar quem consegue efectivamente mostrar e aceder a essa informação.