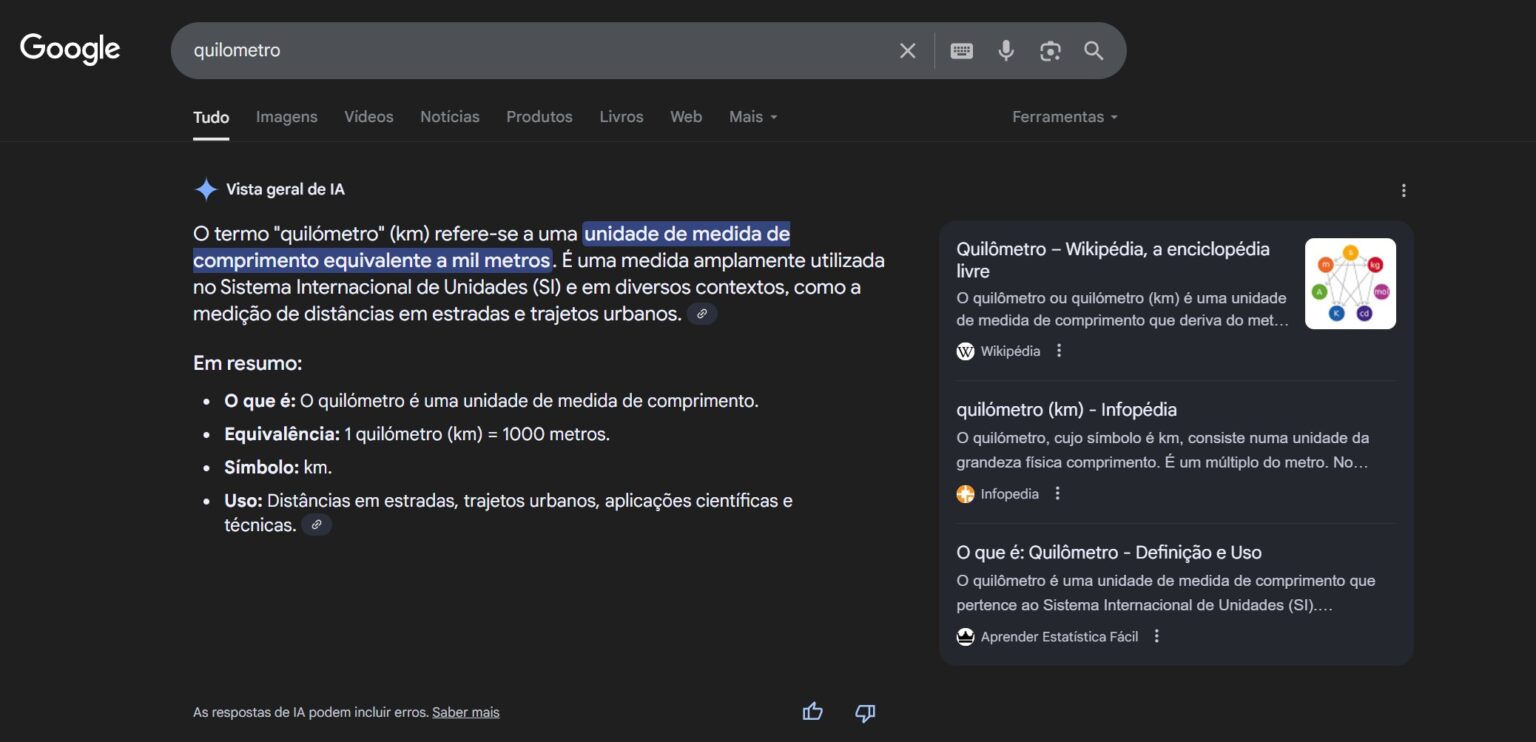

A maioria dos motores de busca integra agora funcionalidades de Inteligência Artificial para mostrar respostas directas aos utilizadores. No entanto, uma notícia recente do The New York Times indica que cerca de um em cada dez resumos, ou Vista geral de IA, gerados pela IA da Google contém informações falsas. Como a empresa processa cerca de cinco biliões de pesquisas por ano, os internautas podem estar a ser expostos a mais de 57 milhões de respostas incorrectas por hora, o que equivale a quase um milhão de erros por minuto.

A evolução da precisão e os testes independentes

Os números têm origem na Oumi, uma startup de IA que avaliou a precisão do modelo Gemini a pedido do jornal norte-americano. Para executar tarefas de análise em grande escala, a empresa utilizou o SimpleQA, uma ferramenta de referência no sector. Os resultados mostram que, em Outubro, o assistente Gemini 2 produziu resumos correctos em 85 por cento das 4326 pesquisas avaliadas. Em Fevereiro, a versão optimizada Gemini 3 conseguiu elevar esse valor para os 91 por cento.

Apesar da melhoria, a avaliação de grandes volumes de dados obriga a recorrer a outras ferramentas de IA, o que pode introduzir novas falhas. Além disso, a Google chega a gerar respostas diferentes para a mesma pesquisa num intervalo de poucos segundos. A preocupação com a fiabilidade destas respostas já levou a empresa a agir drasticamente no passado, como quando decidiu remover os resumos gerados por Inteligência Artificial em pesquisas relacionadas com a saúde para evitar a disseminação de conselhos médicos perigosos.

Um porta-voz da gigante tecnológica já veio a público referir que os testes da Oumi apresentam falhas, com o argumento de que não reflectem o comportamento real dos utilizadores nas pesquisas. Ainda assim, os testes internos da própria Google mostram que o Gemini 3, quando opera de forma independente do motor de busca, alucina em 28 por cento das vezes.

O problema das fontes e a manipulação de dados

Outro grande desafio prende-se com a citação de fontes. A Google tenta apoiar os resultados da sua funcionalidade de IA com links relevantes, mas as páginas sugeridas muitas vezes não sustentam as afirmações do Gemini. Em alguns casos, um resumo incorrecto surge acompanhado de uma ligação com a informação certa. Noutras situações, um texto preciso cita uma fonte com dados errados, ou as páginas sugeridas não oferecem qualquer informação útil. Curiosamente, as discrepâncias entre os textos gerados e as fontes aumentaram após a actualização de Fevereiro, com um salto de 37 por cento no Gemini 2 para 56 por cento com o Gemini 3.

Os investigadores descobriram também que estes sistemas são susceptíveis a manipulação externa. Num dos exemplos documentados recentemente, um jornalista da BBC publicou um artigo num blogue com informações propositadamente falsas e, no dia seguinte, a Google já estava a repetir essas mesmas alegações nos seus resumos.

Perante este cenário, as grandes empresas de tecnologia começam a proteger-se nas letras pequeninas dos termos de serviço. A Microsoft descreve a sua ferramenta Copilot como algo destinado a fins de entretenimento e não para a tomada de decisões importantes. A Google aconselha os utilizadores a verificar sempre as respostas através do browser, enquanto a xAI reconhece abertamente que as alucinações podem ocorrer a qualquer momento.