A Anthropic apresentou um novo modelo de IA no âmbito de uma parceria com a Nvidia, a Google, a Amazon Web Services, a Apple e a Microsoft: o Project Glasswing. O objectivo é «dar às grandes organizações e a entidades governamentais uma ferramenta capaz de identificar vulnerabilidades críticas nos seus sistemas com intervenção humana mínima».

No centro desta iniciativa está o Claude Mythos Preview, um modelo de uso geral que, para já, não será disponibilizado ao público. A decisão prende-se com «preocupações de segurança»: a Anthropic quer «evitar» que esta tecnologia «possa ser usada por actores maliciosos para explorar falhas». O acesso fica, assim, limitado aos parceiros do projecto, que vão utilizar o modelo para «analisar infraestruturas e corrigir pontos fracos antes que sejam explorados».

Segundo Newton Cheng, responsável de cibersegurança da ‘red team’ da Anthropic (uma equipa especializada em testar a segurança de sistemas simulando ataques reais, como se fosse um grupo de hackers, mas com autorização e objectivos defensivos) o objectivo é dar uma «vantagem inicial» às equipas de defesa face a potenciais atacantes.

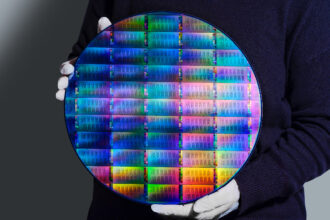

Embora não tenha sido treinado especificamente para cibersegurança, este modelo de IA destaca-se pelas «capacidades avançadas de programação e raciocínio, que lhe permitem identificar falhas complexas em larga escala».

De acordo com a Anthropic, o Claude Mythos Preview já identificou «milhares de vulnerabilidades de elevada gravidade nas últimas semanas», incluindo em todos os principais sistemas operativos e browsers. Um dos aspectos mais relevantes é o nível de autonomia: a empresa garante que o modelo «não só detectou problemas, mas também «fez análises sem qualquer orientação humana directa».