A Anthropic deu início à disponibilização de uma nova funcionalidade de segurança para o modelo de IA especializado em programação Claude Code, capaz de analisar o código-fonte de aplicações em busca de vulnerabilidades e de sugerir correcções imediatas. Esta ferramenta, denominada Claude Code Security, encontra-se actualmente numa fase de antevisão limitada para clientes das modalidades Enterprise e Team, prometendo elevar o patamar da cibersegurança através da inteligência artificial.

Segundo o comunicado oficial da tecnológica, o sistema foi desenhado para realizar a análise de bases de código complexas e propor correcções de software direccionadas para revisão humana. O objectivo passa por permitir que as equipas de desenvolvimento consigam encontrar e resolver problemas de segurança que os métodos tradicionais de análise estática costumam deixar passar.

Defesa contra ataques automatizados

A Anthropic justifica esta aposta com a necessidade de equilibrar o campo de batalha digital. Com o surgimento de agentes de inteligência artificial cada vez mais capazes de detectar falhas de segurança, existe o risco real de os atacantes passarem a utilizar estas mesmas ferramentas para automatizar a descoberta de vulnerabilidades que possam ser exploradas.

Ao lançar o Claude Code Security, a empresa pretende dar aos defensores uma vantagem estratégica. A ideia é utilizar a IA como um escudo, a permitir que as organizações identifiquem fraquezas antes de estas serem aproveitadas por agentes maliciosos. Desta forma, a tecnologia ajuda a melhorar a segurança do software de forma proactiva, em vez de as equipas estarem apenas a reagir a incidentes que já estejam em curso.

Raciocínio humano na análise de código

Uma das grandes diferenças desta ferramenta, segundo a Anthropic, é a sua capacidade de ir além da simples análise de padrões conhecidos. O Claude Code Security foi treinado para aplicar um raciocínio semelhante ao de um investigador de segurança humano. Isto significa que o sistema consegue compreender a forma como os vários componentes de uma aplicação interagem entre si.

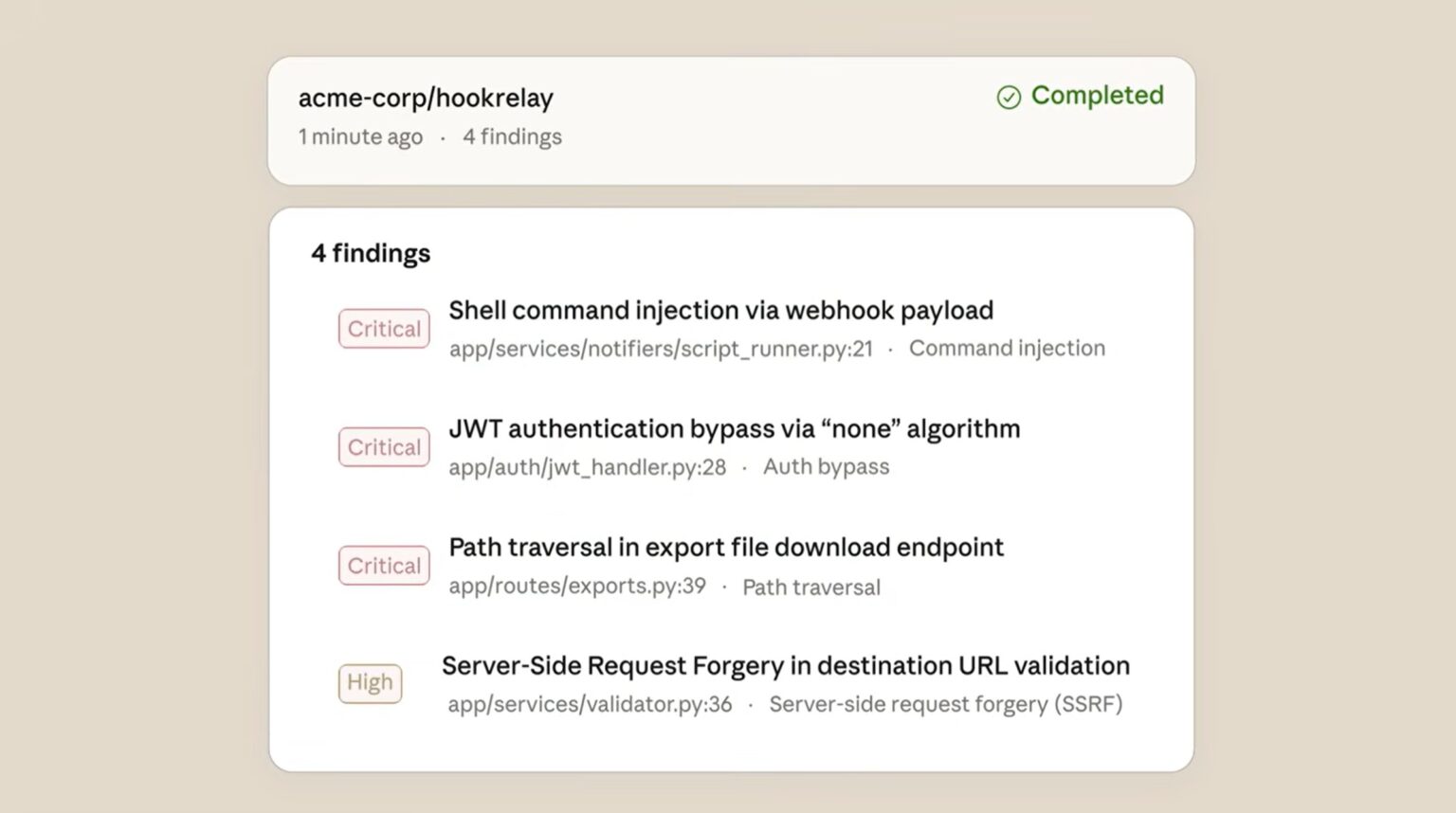

A ferramenta trabalha a rastrear fluxos de dados em toda a aplicação, o que lhe permite assinalar vulnerabilidades lógicas que as ferramentas baseadas em regras rígidas raramente conseguem detectar. Para garantir a precisão dos resultados, cada falha identificada é submetida a um processo de verificação em várias etapas. Este método serve para filtrar falsos positivos e atribuir um nível de gravidade a cada problema, a ajudar os programadores a focar a sua atenção no que é realmente crítico.

O papel central do programador

Apesar da autonomia da inteligência artificial a processar informação, a Anthropic sublinha que o controlo final permanece em mãos humanas. O sistema adopta uma abordagem de “human-in-the-loop”, o que significa que nenhuma correcção é aplicada de forma automática sem o consentimento explícito de um especialista.

Os resultados da análise são apresentados num painel de controlo dedicado, onde os analistas podem rever o código e as sugestões de correcção. Para auxiliar na tomada de decisão, o Claude fornece ainda um índice de confiança para cada descoberta realizada. Esta transparência é fundamental, uma vez que muitas questões de segurança envolvem nuances contextuais que a máquina, por si só, pode não interpretar na totalidade. Assim, o Claude Code Security limita-se a identificar e a sugerir, mas cabe sempre aos programadores a decisão de validar e implementar as soluções propostas.