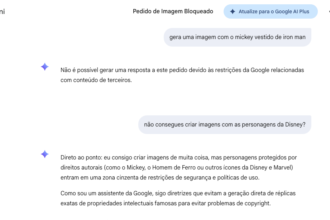

A dona do TikTok lançou um novo modelo de IA generativa capaz de criar vídeos e imagens com potencial para por em sentido as ferramentas da Google (Veo, Nano Banana) e da OpenAI (Sora): o Seedance 2.0. Como as suas concorrentes, combina imagem e som, mas está a surpreender pelos resultados ultrarrealistas.

A ByteDance garante que o novo modelo «representa um salto significativo na qualidade de geração de conteúdos, com melhorias na criação de cenas complexas com múltiplas personagens e na capacidade de seguir instruções».

Neste caso, o Seedance 2.0 permite que os utilizadores refinem os prompts de texto com até «nove imagens, três clips de vídeo e três clips de áudio». Depois, este modelo consegue gerar vídeos até quinze segundos com som, tendo em conta «movimentos de câmara, efeitos visuais e dinâmica de movimento». Para gerar vídeos, a ByteDance diz que também é possível submeter «storyboards baseados em texto», como referência.

Num dos exemplos partilhados pela ByteDance, podemos ver dois patinadores artísticos a executar uma «sequência de movimentos de elevada dificuldade, incluindo descolagens sincronizadas, rotações no ar e aterragens precisas no gelo, com respeito rigoroso pelas leis físicas do mundo real».

Nas redes sociais, já começaram a surgir demonstrações das capacidades ultrarrealistas do Seedance 2.0, que está disponível aqui. Um utilizador publicou um vídeo com Brad Pitt e Tom Cruise numa cena de combate, partilhado depois pelo argumentista de ‘Deadpool, Rhett Reese’: «Custa-me dizê-lo. Provavelmente, acabou para nós», como que a atirar a toalha ao chão, devido às capacidades da IA.

Outras publicações mostram a capacidade do Seedance 2.0 para criar clips em estilo anime e ficção científica, entre outros – uma das questões, claro, é sempre a dos direitos de imagem e de autor. Contudo, a ByteDance não clarificou que tipo de salvaguardas tem esta plataforma. Para já, parecem ser muito leves, dado que há conteúdos a circular no X com personagens de Dragon Ball Z, Family Guy ou Pokémon.