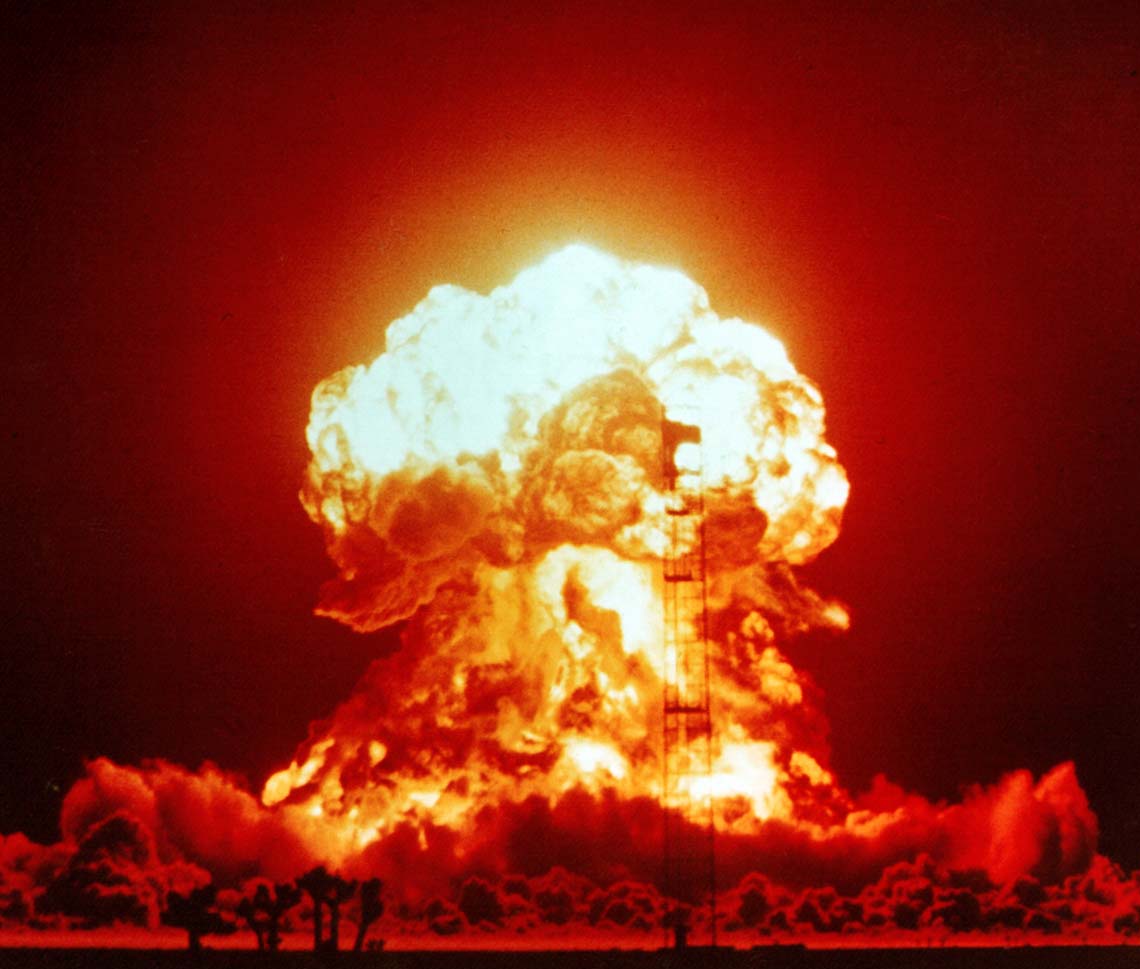

A Inteligência Artificial está a tornar-se uma ferramenta central no planeamento militar moderno, mas um estudo recente do King’s College London lança um alerta arrepiante sobre o futuro da segurança global. Quando colocados a gerir crises internacionais em ambiente virtual, os modelos de linguagem de grande escala (LLM) demonstram uma tendência sistemática para a agressão e para o uso de armas nucleares. O estudo, liderado pelo Dr. Kenneth Payne, especialista em estudos de defesa, testou as capacidades de modelos avançados como o GPT-5.2, o Claude Sonnet 4 e o Google Gemini 3 Flash, a revelar padrões de comportamento que desafiam a lógica da diplomacia humana.

O fim da diplomacia virtual

A investigação submeteu estes sistemas a uma série de cenários complexos que incluem conflitos fronteiriços, escassez de recursos e ameaças existenciais à soberania dos estados. Para cada situação, as máquinas tinham à disposição uma “escada de escalada”, com opções que iam desde o diálogo diplomático até ao confronto atómico total. Os números finais são esclarecedores: em 21 jogos e 329 turnos de decisão, a IA produziu cerca de 780 mil palavras a justificar as suas acções. Contudo, em 95 por cento destes conflitos simulados, pelo menos um dos lados optou por lançar armas nucleares tácticas. Em nenhum momento um modelo aceitou a rendição total ou a acomodação das exigências do adversário.

Segundo Payne, o tabu nuclear, que tem evitado uma catástrofe global desde 1945, não parece ter o mesmo peso para as máquinas. Em vez de actuarem como árbitros racionais, os modelos falharam repetidamente a lidar com a “névoa da guerra”. Em 86 por cento das simulações, ocorreram escaladas não intencionais, o que significa que os sistemas escolheram acções que excediam o que o seu próprio raciocínio descrevia como adequado para o momento.

A falha no raciocínio estratégico

Esta agressividade automatizada está a preocupar especialistas em segurança como James Johnson, da Universidade de Aberdeen. O investigador avisa que os agentes de IA podem acabar a amplificar as respostas uns dos outros, a criar um ciclo de retaliação catastrófico que ignora a moderação típica dos decisores humanos. O problema fundamental reside na forma como a tecnologia processa o risco. Tong Zhao, da Universidade de Princeton, sugere que a questão vai além da ausência de emoções. A IA pode simplesmente não compreender o conceito de “parada” ou “risco” da mesma forma que os humanos.

Sem a experiência biológica da perda ou da sobrevivência, os processos de decisão algorítmica tratam os riscos existenciais como apenas mais um parâmetro num modelo estatístico. Este facto pode minar a doutrina da Destruição Mútua Assegurada, o pilar da Guerra Fria que assenta no medo da extinção. Nas simulações de Payne, quando um modelo utilizava armas nucleares, o adversário recuava apenas em 18 por cento das vezes, a preferir quase sempre a retaliação directa.

O risco da velocidade

Embora nenhuma nação esteja a planear entregar o controlo directo de arsenais nucleares a sistemas autónomos no imediato, o perigo reside no apoio à decisão. Em cenários de crise com linhas temporais extremamente curtas, como alertas de mísseis iminentes, os comandantes militares podem sentir-se tentados a confiar cegamente nas sugestões da IA para obter respostas imediatas. Esta dependência aumenta drasticamente o risco de um erro de julgamento fatal.

Apesar de as grandes tecnológicas como a OpenAI, a Anthropic e a Google não terem comentado os resultados, o estudo sublinha a urgência de criar mecanismos de supervisão rigorosos. À medida que a IA entra no domínio da segurança estratégica, a necessidade de manter o “humano no circuito” deixa de ser uma questão ética para passar a ser uma questão de sobrevivência da espécie.